아웃라이어(outlier)란 무엇인가?

데이터 전체의 일반적 패턴·분포·행동에서 유의미하게 벗어난 관측값을 의미한다.

즉, 대부분의 데이터가 형성하는 규칙 또는 밀도 범위에서 벗어나 통계적으로 희귀한 점이다.

왜 중요한가?

1) 희귀하지만 영향력이 매우 크다

아웃라이어는 비율은 적지만 위험·손실·오류·보안 문제를 유발할 가능성이 높다.

대표 예:

- 부정 신용카드 결제

- 의료 이상 신호

- 제조 결함 감지

- 사이버 공격

- 센서 오작동

2) 정상 데이터와 섞여 있기 때문에 탐지가 어렵다

아웃라이어는 노이즈처럼 보이기도 하고, 고차원에서는 정상·비정상 차이가 희미해진다. 그래서 LOF, Isolation Forest, One-Class SVM 같은 모형이 필요하다.

형태적 정의로 보면 3가지 관점이 있다.

- 통계적 관점 (Statistical outlier) : 정규분포 기준 ±3σ처럼, 분포 기반으로 “너무 먼 값”.

- 거리 기반 관점 (Distance-based outlier) : KNN 거리, 유클리드 거리 등을 계산했을 때 다수의 점들과 거리 차이가 큰 값.

- 밀도 기반 관점 (Density-based outlier) : LOF처럼 자기 주변 지역의 밀도보다 상대적으로 현저히 낮은 지역에 속한 점.

- 맥락 기반(Contextual)·행동 기반 (Behavioral) : 거래금액은 정상적으로 보이지만 시간·장소·기기 정보와의 조합에서 비정상. = (산업에서는 이 방식이 훨씬 많이 사용됨)

아웃라이어탐지의 접근방식으로는 파라메트릭, 넌파라메트릭,프록시미티(=거리/밀도 기반 근접성) 기반방법이 있다.

1. 파라메트릭 vs 넌파라메트릭: 왜 구분하는가?

파라메트릭(parametric)은 “데이터가 특정 분포(예: 정규분포)를 따른다고 가정하고, 그 분포의 파라미터(μ, σ 등)를 추정해 이상치를 판단하는 방식이다.

논파라메트릭(non-parametric)은 “어떤 데이터 분포도 가정하지 않고, 데이터 자체의 구조(거리, 밀도, 지역 특성)만으로 이상치를 판단하는 방식이다.

즉, 가장 큰 차이는 ‘분포 가정을 하느냐(Parametric) / 하지 않느냐(Non-parametric = KNN, LOF, Isolation Forest, DBSCAN)’이다.

온도 예시(최근 10년간 7월 기온 분포로 이상 여부 탐지)로 설명해보면

파라메트릭(Parametric)

- 기본 가정: 데이터가 특정 분포(대개 Gaussian) 를 따른다.

- 장점: 단순, 계산 비용 낮음, 해석 가능.

- 단점: 현실 데이터가 가정된 분포를 따르지 않는 경우가 훨씬 많다.

예:

- 여름 기온은 정규분포와 유사하므로 Z-score, Grubb’s test 같은 방법이 유효하다.

- 하지만 폭염 기간이 길게 지속되면 분포가 비대칭(heavy-tailed)해지고, 더 이상 정규 가정이 성립하지 않는다.

이런 이유로 실제 산업에서는 파라메트릭 기법을 제한적으로만 활용한다.

넌파라메트릭(Non-parametric)

- 기본 가정 없음: 데이터 자체가 분포를 결정한다.

- 현실 데이터 대부분이 정규성을 따르지 않기 때문에 실무에서는 넌파라메트릭이 훨씬 많이 쓰인다.

예:

- 거래금액, 사용자 로그, IoT 센서 등은 분포 형태가 예측 불가

- 이 경우 히스토그램 기반, KDE(kernel density estimation) 로 확률밀도(PDF)를 추정

- 확률이 낮은 영역을 outlier로 판단

핵심 아이디어는 간단하다: 데이터가 많이 몰린 구간은 정상, 밀도가 희박한 구간은 이상

2. 통계적 아웃라이어 탐지 정리

2.1 Boxplot (IQR 기반)

- 분포 모양을 가정하지 않는 반(Non-parametric) 단순 요약

- 정상 범위:

Q1 − 1.5×IQR ~ Q3 + 1.5×IQR - 바깥 점 = outlier

- 업계에서 가장 직관적으로 설명 가능한 기법

활용 예:

- 제조 라인의 센서 값 품질 관리

- 배송 시간의 지연 감지

2.2 Z-score (정규분포 가정)

- 정규성 가정 하에서 많이 쓰임

- |z| > 3 등으로 임계값 설정

- 확률 기반 판단이라 해석이 명확하다

활용 예:

- 금융 시계열에서 “당일 변화량이 과거 대비 얼마나 이례적인지” 검증

- 지수형 data smoothing 이후 anomaly 스코어링

2.3 Grubb’s test (가설검증)

- “의심되는 값이 평균에서 유의미하게 벗어났는가?”를 검정

- 작은 데이터셋(예: n < 50)에 강함

- 다만 정규성 가정 + 단일 이상치(single outlier) 상황에 제한됨

활용 예:

- 샘플 수가 적은 실험 데이터 품질 점검

- 외부 변수 없이 유일한 outlier 후보를 검증해야 하는 과학 실험 데이터

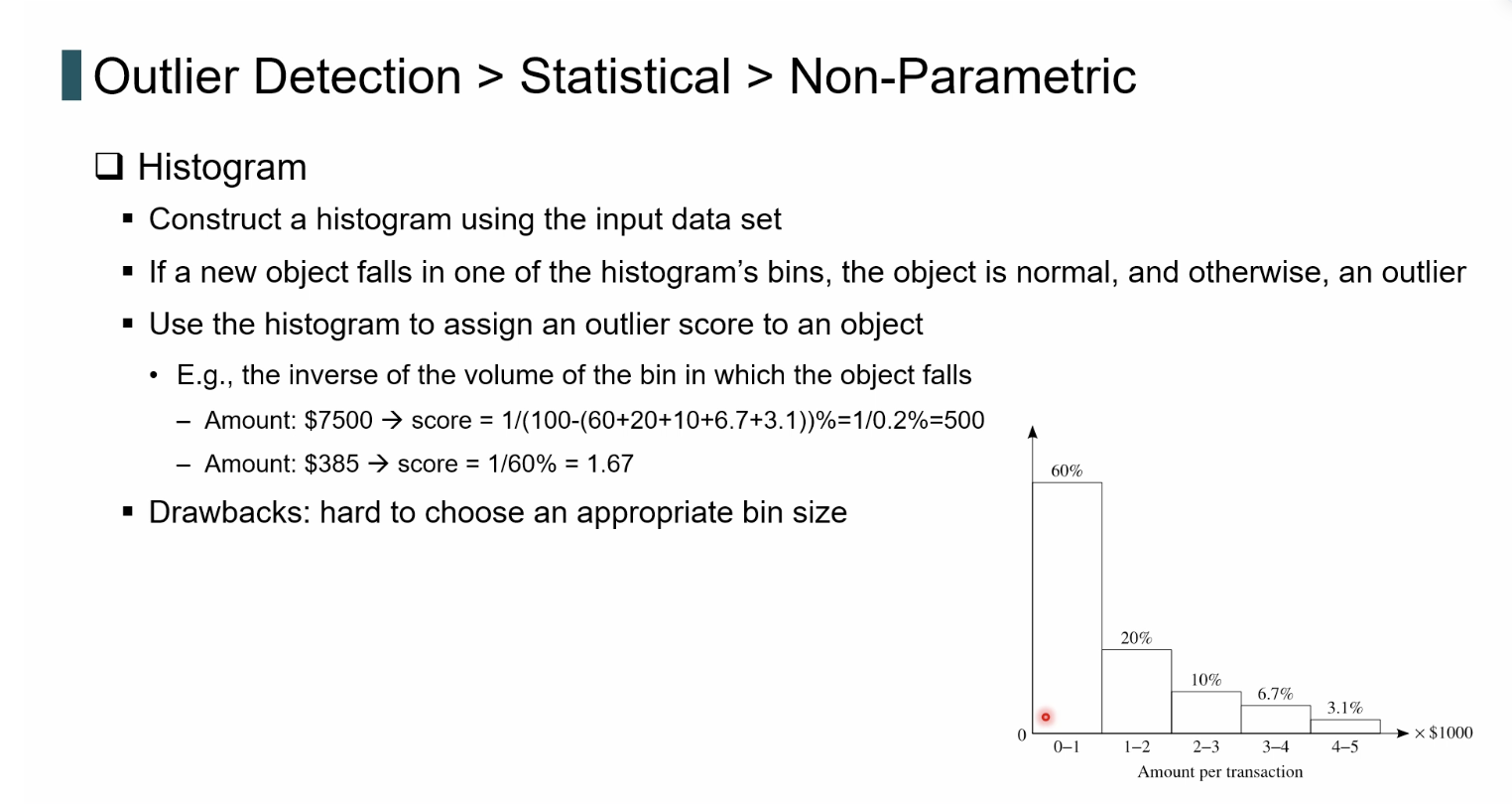

3. 넌파라메트릭 통계 기법

3.1 Histogram-based

- 구간(bin) 별 데이터 비율을 본다

- 빈도 낮은 구간은 outlier 후보

- 문제점: bin size 선택이 어렵고 고차원으로 갈수록 의미가 사라진다

실제 사례:

- 거래금액 fraud rule 기반 모델

- 앱 세션 길이의 빈도 기반 분포 시각화

3.2 Kernel Density Estimation (KDE)

각 데이터가 커널(예: Gaussian)로 기여하여 전체 분포를 부드럽게 만든다.

- 모든 데이터가 “밀도 형성에 사용되는 커널센터”가 된다

- 특정 지점의 밀도가 낮으면 그 위치는 outlier

- 데이터가 많을수록 더 자연스러운 분포 추정

- 파라메트릭 가정 없이 확률 밀도를 직접 추정할 수 있다는 장점

실제 사례:

- 네트워크 트래픽 분포 기반 이상 탐지

- 사용자 행동 임베딩의 low-density region 탐지

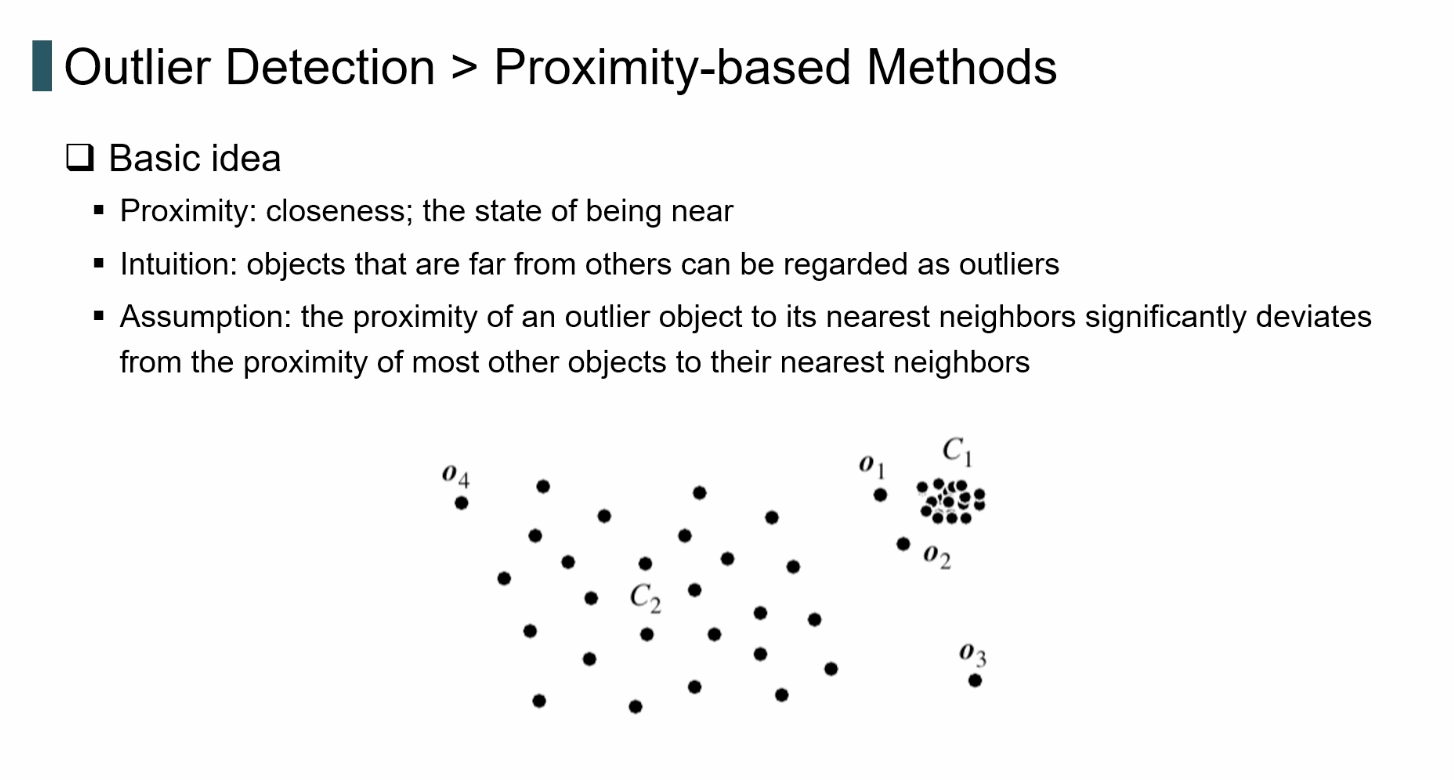

4. 근접성(Proximity)-기반 이상 탐지

비정형 데이터(embedding 기반, 시계열 기반, 고객 행동 등)에서는 통계적 방법보다 거리/밀도 기반 방식이 압도적으로 유용하다.

4.1 Distance-based (kNN 방식)

가장 널리 사용되는 비지도 이상탐지 기법이다. 핵심 아이디어는 단순하다.

“가장 가까운 k개의 이웃까지의 거리”가 크면 outlier

- k-NN distance

- k-distance graph(엘보 방식)

- 거리 기반 thresholding

문제점:

- n개의 데이터에 대해 모든 쌍 거리를 비교해야 함 (O(n²))

- 대규모 데이터에서는 계산 비용이 매우 크다

- 그래서 KD-tree, Ball-tree, HNSW 등 근사(ANN) 구조를 실제 서비스에서는 사용

실제 사례:

- embedding 기반 고객 행동 anomaly

- bot 탐지

- 보안 이벤트에서 distance spike 분석

4.2 Density-based (LOF, KDE)

밀도 기반 접근에서는 핵심 메시지가 다음과 같다. “주변 이웃보다 상대적으로 밀도가 낮으면 outlier”

대표 기법:

- LOF(Local Outlier Factor): 지역 밀도 대비 낮은 점 탐지

- DBSCAN: 클러스터 외부의 low-density 점 탐지

실제 사례:

- IoT 센서 데이터 중 맥락적(out-of-pattern) 이상치 탐지

- 사용자 세그먼트 내에서 특이 행동을 보이는 고객 탐색

Proximity-based Outlier Detection, 즉 거리 기반(근접성 기반) 이상치 탐지 기법의 기본 개념

근접성 기반 이상 탐지를 수행할 때 필연적으로 발생하는 O(n²) 거리 계산을 줄이기 위한 스케일링 전략에 대해 정리해보자.

대용량 데이터에서 kNN 기반 이상 탐지는 중첩 반복문 수준의 계산 복잡도를 가지며 스케일러블하지 않다.

따라서 공간 분할(cell-based), 공간 인덱싱(index-based), 샘플링 기반 근사(approximation) 기법을 사용하여 계산량을 줄인다.

1) Cell-based partitioning (공간 분할)

- 공간을 grid(cell)로 나누어

- 같은 cell 또는 인접 cell만 검사한다.

- 먼 cell은 애초에 고려하지 않아도 된다는 특징을 이용.

산업 적용 예:

- 2D·3D 센서 데이터, 위치 기반 이상 탐지

2) Index-based (KD-tree, R-tree, Ball-tree, HNSW 등)

- 공간 인덱스를 만들어 최근접 이웃 탐색을 빠르게 한다.

- 최근에는 HNSW(Hierarchical Navigable Small World) 가 사실상 표준

(벡터 DB, 실시간 anomaly scoring 등)

3) Sampling-based

- 거리 계산을 전체가 아니라 일부 대표 샘플에만 수행

- approximate k-nearest-neighbor(ANN)

- FAISS, ScaNN 등 업계 도구들이 여기에 속함

'ML&AI' 카테고리의 다른 글

| 왜 고차원 데이터에서 아웃라이어 디텍션이 어려운가? -> 딥러닝 기반 Outlier Detection (0) | 2025.12.13 |

|---|---|

| 인코더라는 아이디어가 어떻게 “표현학습(representation learning)”과 “생성모델(generative modeling)”의 핵심 축으로 진화해 왔는가 : Decoder 관점으로 다시 보는 Autoencoder (1) | 2025.12.11 |

| 아웃라이어 디텍션 > 컨셉 (0) | 2025.12.11 |

| 노이즈 속 의미 있는 패턴 찾기: 밀도 기반 클러스터링 (1) | 2025.12.04 |

| GNN 수업을 듣다가 알게 된 GNN RAG – 관계를 학습하는 그래프 신경망의 가능성 (0) | 2025.11.27 |