이번 학기 기계학습 수업에서 GNN(Graph Neural Network)을 배우면서, 단순히 그래프 구조 데이터를 처리하는 모델이라는 개념을 넘어서 실무적인 활용 가능성까지 함께 고민해 보게 되었다.

특히 그래프 RAG(Retrieval-Augmented Generation) 시스템과 GNN을 결합할 수 있다는 아이디어가 떠올랐고, 그 과정에서 관련 논문(GNN-RAG: Graph Neural Retrieval for Large Language Model Reasoning, 2024)을 찾아보면서 큰 인사이트를 얻었다.

출발점: GNN은 ‘관계’를 학습한다

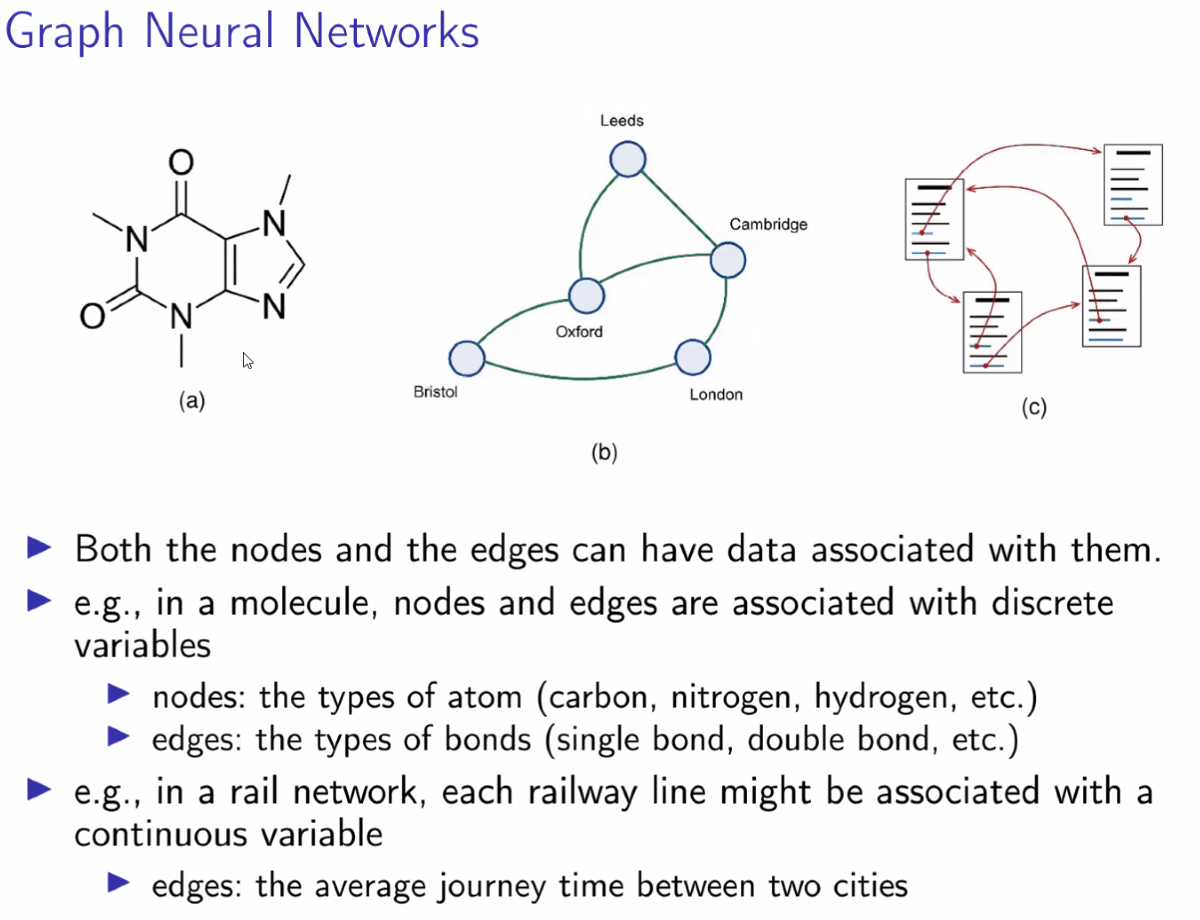

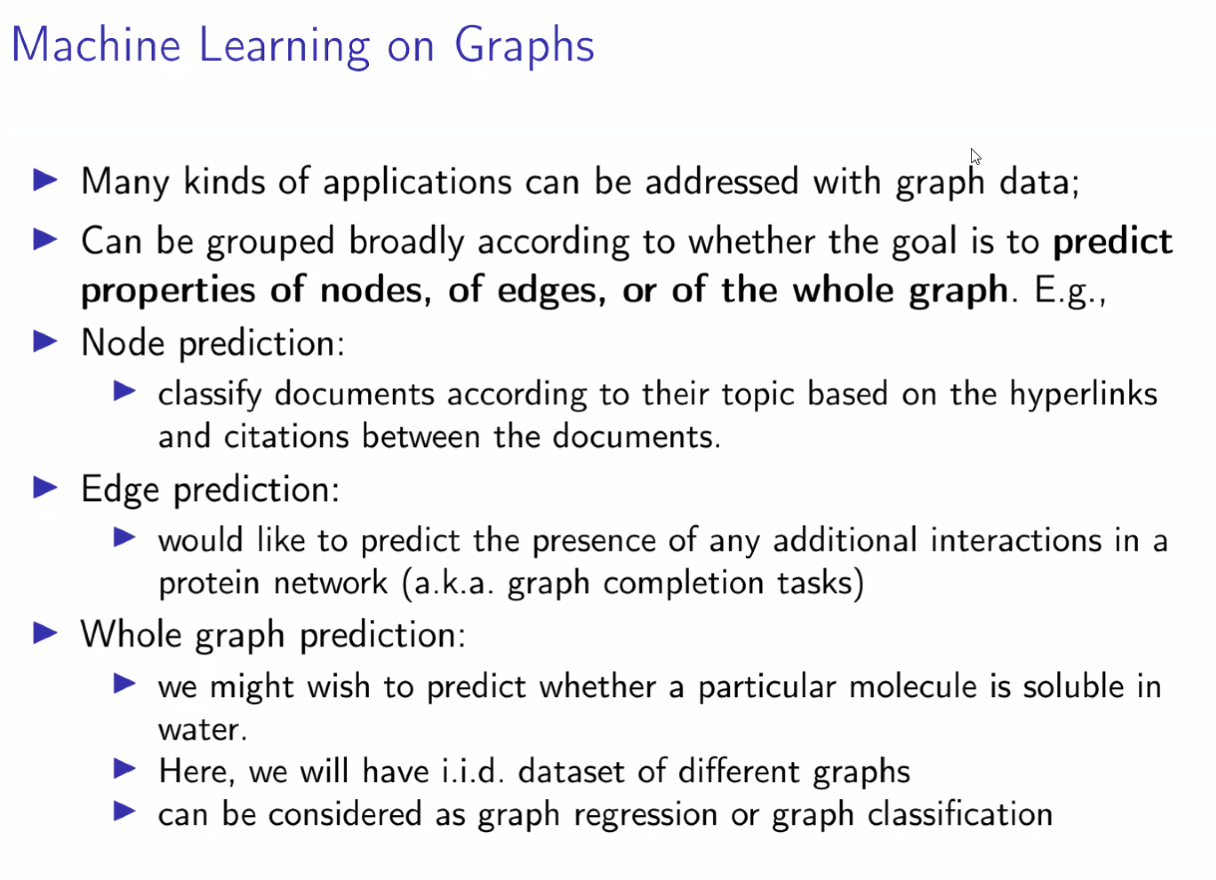

GNN은 CNN이나 RNN처럼 고정된 형태의 입력(2D 이미지, 1D 시퀀스)을 다루지 않는다.

노드(Node)와 엣지(Edge)로 이루어진 그래프 구조 데이터를 입력으로 받고,

각 노드가 이웃 노드로부터 정보를 받아 자신의 표현을 갱신하는 메시지 패싱(Message Passing) 구조를 가진다.

이 과정을 통해 GNN은 단순히 개별 노드의 특징뿐 아니라,

그 노드가 어떤 관계를 맺고 있는지를 함께 반영한 임베딩을 만들어 낸다.

즉, GNN은 “관계 패턴”을 학습한다.

이 관계 패턴은 모델의 가중치(parameter)로 저장되고,

학습이 끝나면 각 노드의 임베딩(relationship-aware representation)이 그래프DB(예: Neo4j)에 저장되어 활용된다.

어떤 태스크에 쓸건가

색인 단계에서의 GNN: 관계 기반 임베딩 학습

RAG 시스템에서 색인(indexing)은 문서를 임베딩 벡터로 변환해 저장하는 과정이다.

일반적으로는 텍스트 임베딩 모델(BERT, E5, KoSimCSE 등)을 이용해 문서 자체의 의미만 벡터화하지만,

그래프 기반 색인에서는 문서 간의 연결 관계(인용, 언급, 주제 연관 등) 도 함께 고려할 수 있다.

이때 GNN을 사용하면, 문서 노드의 임베딩이

“이웃 문서의 정보까지 포함된 표현”으로 학습된다.

이 과정을 거치면 그래프 구조 전체의 의미적 패턴이 모델 파라미터에 녹아들고,

모든 노드의 관계 기반 임베딩이 사전 계산되어 저장된다.

색인이 끝나면 GNN 모델의 학습도 함께 종료된다.

그 결과로 두 가지가 남는다.

(1) 관계 패턴을 학습한 GNN 모델

(2) 모든 노드의 관계 반영 임베딩

이 임베딩은 보통 Neo4j의 노드 속성(property)으로 저장되거나

FAISS, Milvus 같은 벡터 데이터베이스에 색인 형태로 보관된다.

검색 단계에서의 GNN: 잠재 관계 탐색과 확장 검색

검색 단계에서는 사용자의 쿼리(질문)가 들어온다.

전통적인 BM25나 임베딩 기반 검색은 단어 유사도 혹은 문맥적 의미 유사도만으로 후보 문서를 찾는다.

반면 그래프 기반 검색은 문서 간의 관계를 통해 확장 검색을 수행할 수 있다.

Neo4j 같은 그래프 데이터베이스는 명시된 관계를 빠르게 탐색하지만,

연결이 존재하지 않는 노드 간의 잠재적인 관계는 찾지 못한다.

이때 GNN을 사용하면, 학습된 관계 패턴을 바탕으로

엣지가 명시적으로 없더라도 의미적으로 가까운 노드를 예측할 수 있다.

즉, 쿼리 노드와 문서 노드 사이의 “연결 확률”을 추정하는 링크 예측(link prediction) 과정이 가능해진다.

이러한 접근은 “multi-hop” 관계, 즉 여러 단계를 거쳐야 도달할 수 있는 연결을 학습적으로 포착할 수 있게 한다.

결과적으로 단순 임베딩 검색보다 더 풍부한 문맥과 근거를 가진 검색 결과를 제공한다.

실제 연구 사례: GNN-RAG의 예시

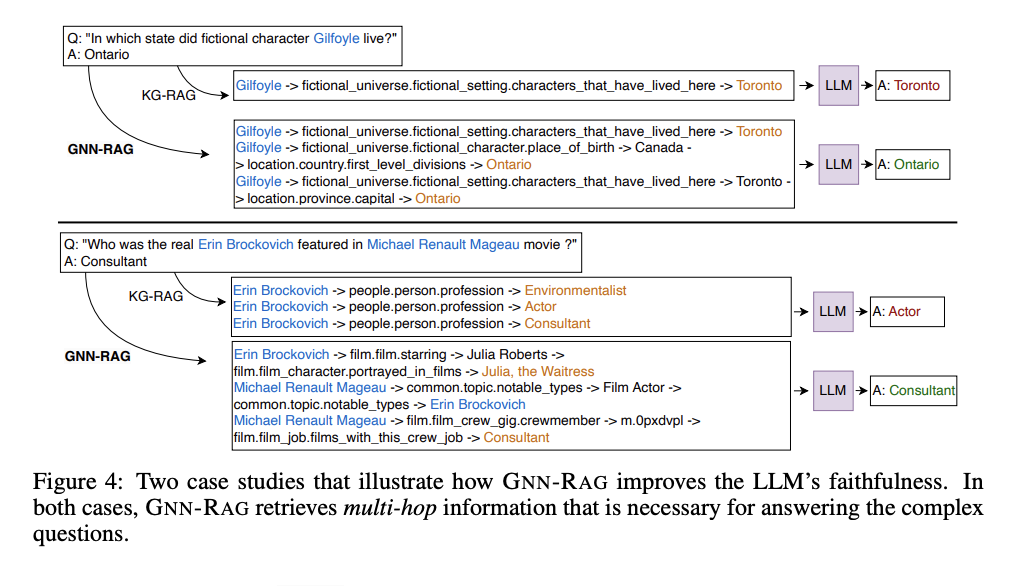

GNN-RAG 논문에서는 이러한 아이디어를 실제로 구현한 사례를 보여준다.

예를 들어, ‘가상의 인물 Gilfoyle이 살았던 주(state)는 어디인가?’라는 질문에 대해

전통적인 KG-RAG(Knowledge Graph RAG)는 단일 경로 탐색만 수행해 잘못된 답을 내지만,

GNN-RAG는 다중 경로(multi-hop) 관계를 학습적으로 추론하여 정확한 답인 ‘Ontario’를 찾아낸다.

또 다른 예로, ‘영화에 등장한 실제 Erin Brockovich는 누구인가?’라는 질문에서도

KG-RAG는 단순한 역할 정보만 반환하지만,

GNN-RAG는 영화 등장 인물, 관련 인물, 직업 등의 다단 관계를 통해

최종적으로 “Consultant”라는 정답을 찾아낸다.

즉, GNN-RAG는 LLM이 답을 생성하기 전에

그래프 내에서 필요한 multi-hop 정보를 찾아 요약해 주는 역할을 한다.

이는 LLM의 정확성과 근거 충실성을 동시에 향상시킨다.

GNN이 주는 이점과 한계

이점

- 관계 기반 표현학습

노드 임베딩이 개별 텍스트 의미뿐 아니라 그래프 구조적 문맥을 반영. - 잠재 관계 추론

명시적 엣지가 없어도, 학습된 패턴으로 새로운 연결 가능성 예측. - 멀티홉 reasoning

여러 단계를 거쳐야 찾을 수 있는 정보(간접 관계)를 학습적으로 포착. - LLM 보조

LLM이 직접 reasoning하기 전에 필요한 그래프 요약을 제공해 정확도 향상.

한계

- 학습 비용과 메모리 요구가 큼 (대규모 그래프에서는 미니배치 샘플링 필요)

- 색인 데이터가 바뀔 때마다 재학습이 필요

- 그래프가 불완전하거나 노이즈가 많으면 성능이 불안정할 수 있음

정리하며: 왜 연구 주제로 가치가 있는가

현재 대부분의 RAG 시스템은 단순 벡터 검색 기반이다.

문서 간의 관계를 직접 활용하지 않기 때문에,

다단 논리 추론(multi-hop reasoning)이나 복잡한 질의에 취약하다.

GNN을 색인 및 검색 파이프라인에 결합하면,

관계 패턴을 학습적으로 요약하고 잠재 연결을 확장할 수 있다.

이 영역은 아직 산업에서도 실험적인 단계이고,

학계에서도 “RAG + GNN”을 이론적으로 정립하려는 시도가 이제 막 활발해지는 중이다.

그래서 기계학습 수업 시간에 배운 GNN의 개념이

이렇게 실질적인 시스템 설계와 연결된다는 사실이 매우 흥미로웠다.

트랜스포머가 단어 간 문맥을 학습하듯,

GNN은 노드 간 관계 문맥을 학습한다는 점이 특히 인상 깊었다.

이 개념은 단순한 응용을 넘어, 앞으로 연구로 확장될 가능성이 충분하다.

https://arxiv.org/abs/2405.20139

https://www.mdpi.com/2079-9292/14/11/2102

https://aclanthology.org/2025.findings-naacl.232

'ML&AI' 카테고리의 다른 글

| 아웃라이어 디텍션 > 컨셉 (0) | 2025.12.11 |

|---|---|

| 노이즈 속 의미 있는 패턴 찾기: 밀도 기반 클러스터링 (1) | 2025.12.04 |

| JSON / Function-Call 기반 스트럭처드 아웃풋은 응답시간(latency)과 토큰 비용이 확실히 증가하는 경향이 있다. (0) | 2025.11.03 |

| 이미지를 이해하는 신경망의 눈: 스케일, 바운딩박스, 그리고 NMS (0) | 2025.10.30 |

| 대화 인텐트 분류, BERT에서 GPT까지 — 분류의 본질을 다시 생각해보자. (0) | 2025.10.30 |