반응형

1. Fixed Basis Functions의 아이디어

- 입력 를 임의의 기저 함수(basis functions) 로 변환

- 선형 결합 + 비선형 활성화로 출력 y(x,w)y(\mathbf{x}, \mathbf{w}) 계산

- 이론적으로, 충분히 풍부한 basis function을 준비하면 임의의 함수도 근사 가능

→ 즉, linear regression 구조만으로도 어떤 문제든 "수학적으로는" 풀 수 있음.

2. 그럼에도 불구하고 한계가 생기는 이유

- 현실에서는 어떤 basis function을 선택해야 할지 알기 어려움

- 필요한 basis function 수가 입력 차원 DD 에 따라 기하급수적으로 증가

- 예: 다항식 회귀(polynomial regression)

- DD차원 입력일 때: 항의 개수 ∼O(DM)\sim O(D^M)

- → 차원이 늘어나면 매개변수 수가 폭발 (parameter explosion)

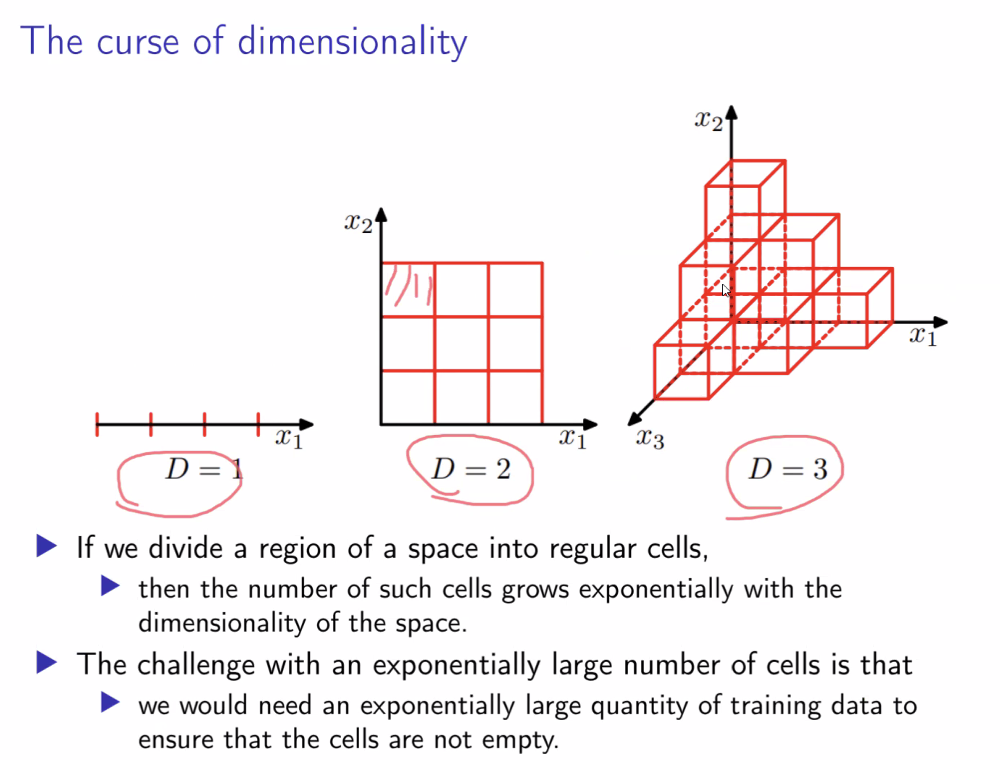

3. 차원의 저주 (Curse of Dimensionality)

- 입력 차원이 커질수록

- 학습해야 할 basis function의 수가 기하급수적으로 많아짐

- 데이터가 고차원 공간에 흩어져 밀도가 낮아짐

- 학습 데이터가 엄청 많아도 부족해짐

- 즉, 이론적으로는 가능하지만 실질적으로 불가능한 상황 발생

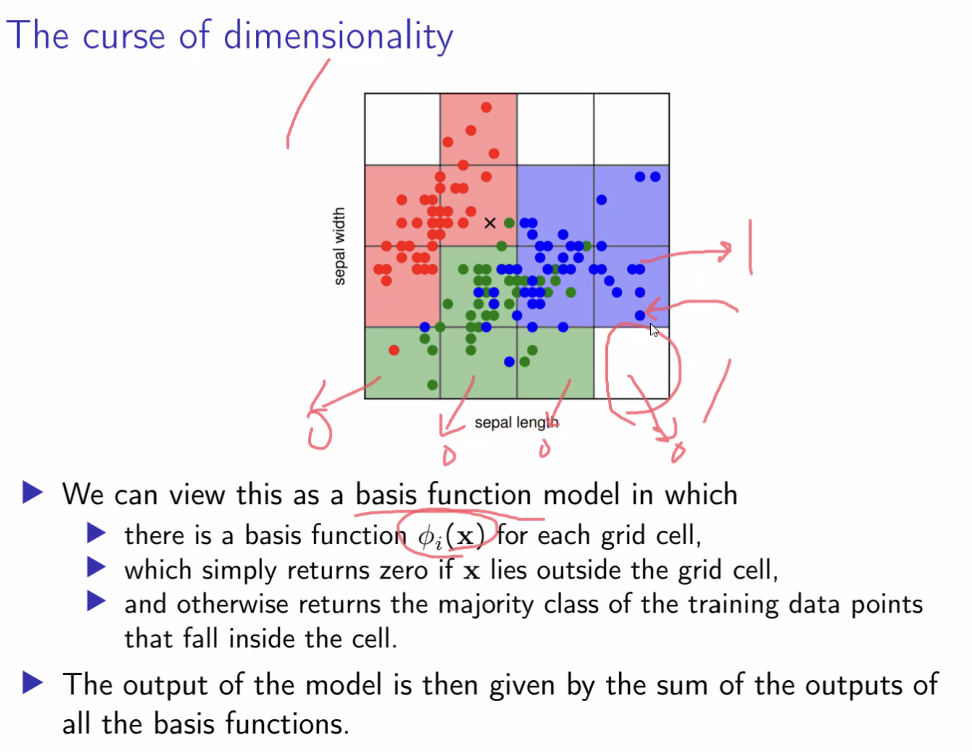

4. Iris 예제

- 아이리스 데이터 (꽃잎 길이/폭으로 3종류 꽃 분류)

- 단순 선형 모델로는 클래스 경계가 제대로 표현되지 않음

- 기저 함수를 늘려서 보완할 수는 있지만,

- 고차원에서는 구간을 나누는 셀(cell) 수가 폭발적으로 늘어나

- 학습이 비현실적으로 어려워짐

고차원 공간에서 데이터는 sparse(희소) 하게 되고, 이게 바로 차원의 저주의 또 다른 표현을 보여주는 그림이다.

- 가 커지면, 아주 작은 epsilon만으로도 부피 대부분이 겉껍질(shell) 에 몰려버림.

- 예:

- D=1D=1: 거의 선분 길이만 줄어드는 직관적 변화

- D=20D=20: 반지름이 살짝만 줄어도 내부 부피가 확 줄어들고, 구의 부피 대부분이 바깥쪽 얇은 층에 집중됨

4-1. 그럼 실제 데이터는 정말 그렇게 고차원 전부를 다 쓰고 있을까?

- Data Manifold 가설

- 데이터는 고차원 전체 공간에 퍼져 있는 게 아니라

- 저차원 매니폴드(manifold) 위에 놓여 있음

- 매니폴드 = “국소적으로는 유클리드 공간처럼 보이는 곡면”

- 예: 2차원 종이를 말아서 원통에 올려놓으면 → 전체는 3D 공간에 있지만 실제 자유도는 2D

- 정리해보면...

- "차원이 너무 커서 데이터가 희소하다 → 학습이 어렵다”

- 여기서: “하지만 실제 데이터는 저차원 매니폴드 위에 있다 → 희소성 문제가 완화될 수 있다”

- 즉, 차원의 저주를 극복할 단서가 바로 데이터 매니폴드 구조

- 그렇다는 얘기는 희망적이다? (성능향상측면에서)

- 픽셀 공간(고차원)을 직접 다루는 대신

- 신경망이 자동으로 데이터가 놓여 있는 매니폴드를 학습

- 의미 있는 저차원 표현(latent representation) 을 찾아내는 역할을 함.

5. DNN(딥뉴럴네트워크)가 필요한 이유

- DNN은 이런 셀 단위로 전부 쪼개지 않고,

- 데이터 분포에서 중요한 feature만 자동으로 학습

- 공간을 효율적으로 나누는 비선형 결정 경계(decision boundary)를 형성

- 결국, 딥러닝은 차원의 저주 문제를 직접 해결하지는 못해도,

- 불필요하게 많은 basis function을 전부 쓰지 않고,

- 계층적으로 feature를 추출해서 고차원 데이터도 실질적으로 분류 가능하게 만듦.

- 딥러닝은 basis function을 사람이 직접 설계하지 않고, 네트워크가 데이터로부터 자동 학습

- 은닉층 뉴런들이 적응형 비선형 basis function 역할을 함

- 고차원 데이터에서도 공유 파라미터, 계층적 표현 학습으로 curse of dimensionality 완화 가능

반응형

'ML&AI' 카테고리의 다른 글

| 딥러닝 표현학습의 흐름: 프리트레이닝·파인튜닝·메타러닝·대조학습 그리고 CLIP (1) | 2025.09.11 |

|---|---|

| 팔로업 질문 생성(Follow-up Question Generation) 회고 + Rewarding What Matters (2024)은 TOD & 멀티턴 Flan-T5모델 다시 살펴보기 (0) | 2025.09.06 |

| 생성형모델로 생성한 이미지 품질을 정량적으로 감지할 수 있을까? EvalGIM, TypeScore 논문리뷰 (2) | 2025.08.24 |

| Task-Oriented Dialogue 시스템에서 Follow-up 질문 생성 실험 정리 (Day 3~4) (4) | 2025.08.03 |

| 프롬프트 설계와 관련해 작업 중에 자주 참고하는 내용들을 정리한번 하고 가자. (6) | 2025.07.17 |