강화학습(RL)은 작업 지향 대화 시스템(TOD)을 향상시키는 강력한 접근법이다. 하지만 기존의 RL 방법들은 주로 대화 정책 학습(DPL)이나 응답 생성(RG)에 초점을 맞추고, 대화 상태 추적(DST)은 간과하는 경향이 있다. 이러한 편향은 이해와 생성 간 상호작용을 무시하게 되어 전체적인 성능 최적화를 어렵게 만든다.

또한, 기존 RL 방식은 희박하고 지연된 보상 문제를 겪는다. 이를 해결하기 위해, 이 논문은 이해(DST)와 생성(RG) 모두에 강화학습을 확장하고, 토큰 생성 중 단계별 보상을 도입한다.

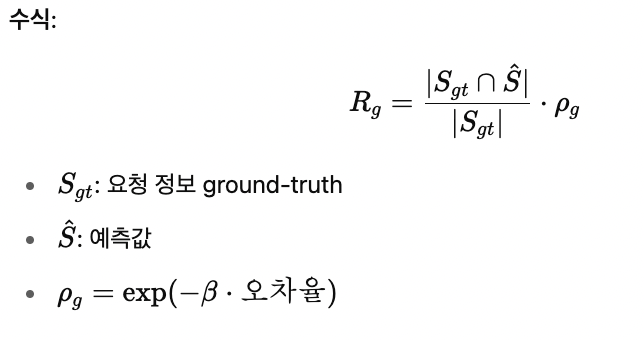

보상이 주어지는 곳은 2곳이다.

- 이해 보상: DST에서 슬롯이 올바르게 채워질수록 증가

- 생성 보상: 사용자 요청을 정확히 반영할수록 증가

작업 지향 대화 시스템(TOD)이 달성해야 할 목표를 의미하는 그림이다.

해당 논문에 따르면 Flan-T5 Base를 백본으로 학습한 모델이다. Flan-T5 Base 사전학습 모델을 기반으로, TOD 작업에 맞춰 지도학습과 강화학습을 통해 파인튜닝한 모델이라고 볼수 있다. Flan-T5(Google Research)와 GALAXY(Alibaba Group)는 둘 다 작업 지향 대화(Task-Oriented Dialogue, TOD)에서 많이 사용되는 대표적인 기반 모델들이다.

Flan-T5

- Flan-T5 Base (약 250M 파라미터)

- Google이 공개한 instruction-tuned T5 계열 모델

- 다양한 자연어 과제에서 사용되는 범용 사전학습 모델

- 다양한 자연어 처리 작업(instruction following, QA, summarization 등)을 위해 few-shot / zero-shot / instruction tuning 방식으로 사전학습(pretrained)

- text-in → text-out 형태의 입력/출력 구조를 가지며, 범용성이 뛰어남

- 일반 LLM보다는 경량화되어 있고, instruction following이 잘 되어 있어 TOD 파인튜닝 시 효율적

- 이 논문에서도 Flan-T5를 백본(backbone)으로 선택해 TOD 시스템으로 fine-tuning 함

GALAXY

- Semi-supervised 학습 + 명시적 정책 주입(explicit policy injection) 방식 적용

- 다양한 TOD 데이터셋으로 사전학습(pretraining)된 후, downstream 데이터셋(MultiWOZ 등)으로 파인튜닝됨

- End-to-End 방식임에도 불구하고, 중간에 policy 정보를 구조적으로 반영함으로써 성능 향상

- 사전 학습된 TOD 전용 모델로, 최근 다양한 RL 기반 모델들과의 성능 비교 대상으로 자주 쓰임

- 이 논문에서도 비교 대상 중 하나로 포함됨

시스템의 작업 흐름

- 이해 단계: Dialogue State Tracking (DST)

- Slot: area, type

- Value: center, guest house

- 정책 학습: Dialogue Policy Learning (DPL)

- 필요한 정보: phone

- 응답 생성: Response Generation (RG)

- 응답: "도심 게스트하우스의 전화번호는 ...입니다."

지도 학습(SFT)과 강화 학습(RL)을 결합하여 TOD 시스템을 향상시키고자 한다.

SFT는 RL을 위한 안정적인 초기 기반을 제공할 수 있으나(Ramamurthy et al., 2023; Yu et al., 2023; Li et al., 2023),

모든 정답 토큰을 동일한 목표로 취급하기 때문에 작업(task)-특화 목표를 우선시하지 못한다.

이에 따라 이 논문에서는 RL을 활용하여 모델을 작업 완성도(task completion) 기준으로 미세조정한다.

TOD 작업에서, 사용자 요구를 정확히 이해하는 것(즉, belief state 추정)은 적절한 대화 행위(dialogue act)를 생성하기 위한 핵심이다.

이것이 적절해야만 시스템 응답이 사용자의 요구를 충족시키고, 대화를 효과적으로 진전시킬 수 있다.

보상 설계 (Reward Design for TOD)

최근 연구들은 정적인 데이터셋으로도 안정적인 학습을 위해 오프라인 강화학습(offline RL)이 유망한 방식이라고 제시합니다.

오프라인 RL의 원칙을 따르며, 많은 기존 방법들은 대화 전체 또는 턴 단위로 보상을 제공해왔습니다.

그러나 이런 방식은 보상 신호가 희박(sparse)하게 발생한다는 한계가 있습니다.

이를 해결하기 위해

- 역강화학습(IRL), 보상 shaping 기법들이 도입됨

- 하지만 IRL은 계산 비용이 크고, shaping은 잘못 설계 시 의도치 않은 행동을 유발할 수 있음

일부 방법은 모든 토큰마다 보상을 부여하는 시도도 있지만, 이는 대화 목표와는 무관한 보상일 수 있습니다. 이 논문에서는 목표 지향적으로 점진적인 보상(progressive goal-oriented reward)을 직접 제공하는 방식이 도입됩니다.

Task Completion Metrics (작업 완료 측정 지표)

대화 시스템의 목표 달성 여부를 측정하기 위해 MultiWOZ와 같은 데이터셋에는 보통 두 가지 리스트가 사용된다. "시스템이 대화 흐름 중 계속해서 informable/requestable 리스트를 만족하는 방향으로 생성하는지” 를 연속적으로 측정하는 것이 중요하다.

- Informable list: 사용자의 요구사항을 나타내는 슬롯-값 쌍 예: 음식점에서 "가격대=저렴함"

- slot-value 보상은 시스템의 이해력을 향상

- Requestable list: 사용자가 요청한 정보 예: 전화번호, 주소 등

- value 보상은 시스템의 반응성(응답의 적절성)을

- Inform 지표는 시스템이 사용자의 요구를 올바르게 학습했는지를 평가한다.

- Success 지표는 시스템이 requestable 리스트의 모든 항목을 포함했는지를 측정한다.

Step-by-Step Goal-Oriented Reward (단계별 목표 지향 보상)

- 이해 보상 (Understanding Reward) : 토큰 생성 중 얼마나 많은 informable 슬롯이 정확히 채워졌는지에 따라 보상.

- 생성 보상 (Generation Reward) : requestable 리스트에 있는 정보가 얼마나 정확히 포함되었는지를 기반으로 보상.

LLM과의 통합 실험 (Integration with LLMs)을 보면 보상 함수가 소형 정책 모델(policy model)의 성능을 확실히 향상시킴을 입증한걸 알수 있다.

저자원 환경에서의 모델 성능을 평가한 결과를 보여주는 위 실험은 전체 학습 데이터의 5%부터 50%까지를 단계적으로 샘플링하여 진행되었으며, Match, SuccF1, BLEU의 세 가지 평가 지표를 사용하였다.

Ours-base 및 Ours-large은 모든 샘플 비율 구간에서 기존 강력한 사전학습 기반 모델인 SPACE-3와 GALAXY를 안정적으로 능가하는 성능을 나타냈다. 특히, Ours-base는 5%의 극히 적은 데이터만으로도 높은 Match(75% 이상)와 SuccF1(80% 수준)을 달성했으며, BLEU 점수 또한 15 이상으로 우수한 유창성을 확보했다.

반면, GALAXY는 20% 구간까지 Match와 SuccF1 점수가 거의 0에 수렴하는 등 극단적으로 불안정한 성능을 보였고, BLEU 역시 모든 구간에서 상대적으로 낮은 수치를 기록했다. SPACE-3는 데이터가 증가함에 따라 꾸준한 성능 개선을 보였지만, 동일한 조건에서 Ours 모델만큼의 빠른 성능 회복은 보이지 않았다.

이러한 결과는 제안된 단계별 목표 지향 보상(step-by-step goal-oriented reward)이 데이터가 부족한 환경에서도 효과적인 학습 신호를 제공함으로써, 모델의 일반화 능력과 빠른 적응력을 향상시킴을 시사한다. 특히 Ours-base 모델은 Ours-large에 비해 소량의 데이터에 대해 더 효율적으로 반응하며, 실용적인 상황에서의 적용 가능성도 높음을 보여준다.

'ML&AI' 카테고리의 다른 글

| 프롬프트 설계와 관련해 작업 중에 자주 참고하는 내용들을 정리한번 하고 가자. (6) | 2025.07.17 |

|---|---|

| MultiWOZ 2.4 대화셋 정리하기 1 - 베이스라인 구축과 Follow-up Question 정의 (2) | 2025.07.13 |

| 멀티레이블 분류 모델 개발 파이프라인 (KoBERT 기반에 광고메시지 유형 분류모델) (3) | 2025.06.28 |

| Value Function Approximation : Q-learning과 DQN 정리 (0) | 2025.06.17 |

| Value Function Approximation - 1 (0) | 2025.06.17 |